O avanço da inteligência artificial tem transformado profundamente a forma como nos comunicamos, aprendemos e buscamos informações.

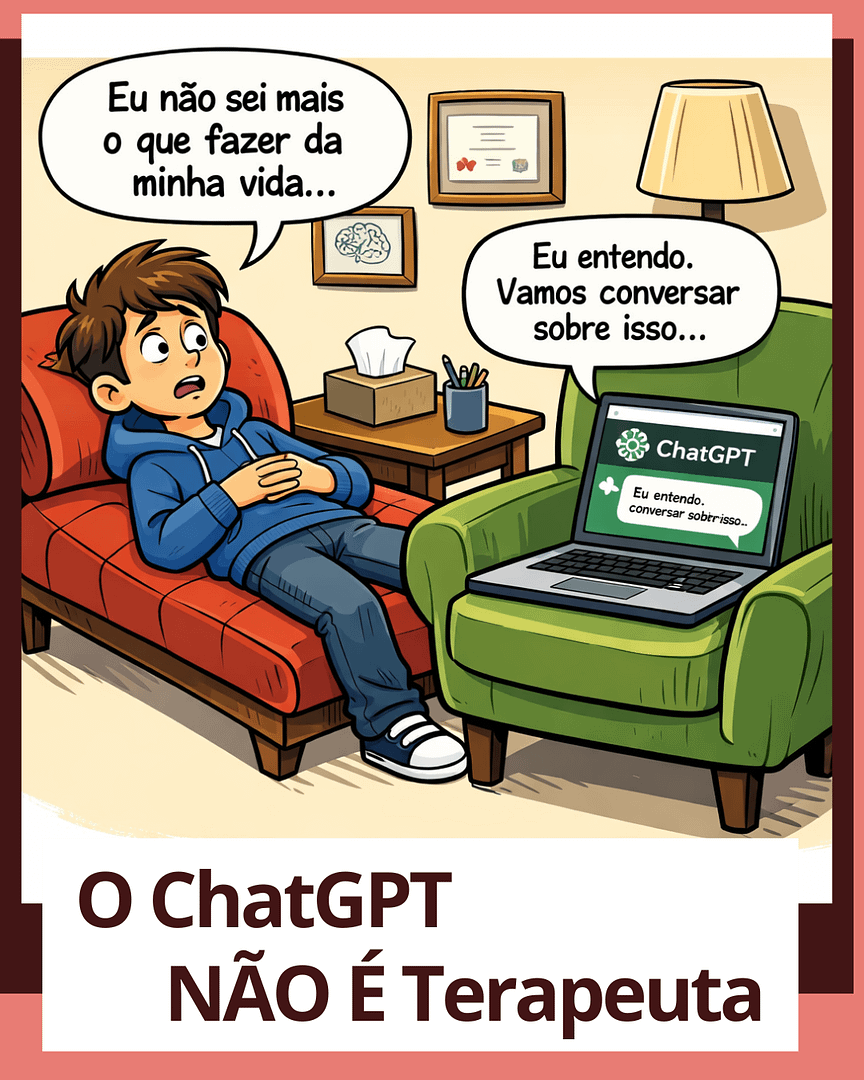

Entre essas transformações, um fenômeno recente merece atenção especial: o uso do ChatGPT e de outras IAs como fonte de aconselhamento emocional e psicológico, especialmente por adolescentes.

Embora a tecnologia possa ser uma ferramenta de apoio e reflexão, especialistas e a própria OpenAI, empresa responsável pelo ChatGPT, alertam: a IA não deve ser usada como substituta de profissionais de saúde mental.

O crescimento do uso da IA como apoio emocional

Adolescentes e jovens adultos têm recorrido cada vez mais à inteligência artificial para falar sobre sentimentos, conflitos internos, dúvidas existenciais e problemas emocionais. Entre os motivos mais comuns estão:

- Medo de julgamento

- Vergonha de se abrir com familiares ou amigos

- Falta de acesso imediato a profissionais

- Sensação de acolhimento e resposta rápida oferecida pela IA

O problema surge quando esse uso passa de pontual para exclusivo, substituindo relações humanas e apoio profissional.

O posicionamento oficial da OpenAI

A OpenAI é clara em suas políticas: o ChatGPT não foi criado para oferecer aconselhamento psicológico, diagnóstico ou tratamento clínico. A ferramenta pode fornecer informações gerais, “ajudar na organização de pensamentos” (essa é uma colocação da OpenAI, que eu discordo) e estimular reflexões, mas não substitui o olhar clínico, a escuta qualificada e a responsabilidade ética de um profissional de saúde.

Nos últimos anos, a empresa implementou os chamados guardrails — barreiras de segurança — para lidar com temas sensíveis como sofrimento emocional, ideação suicida e dependência emocional da IA. Quando esses sinais são identificados, o sistema tende a:

- Evitar conselhos diretos e personalizados

- Incentivar pausas no uso

- Sugerir a busca por ajuda humana

- Redirecionar para redes de apoio e serviços especializados

Essas medidas existem justamente porque a IA tem limites claros quando o assunto é saúde mental. Mas, infelizmente, na prática não funcionam.

Os riscos do isolamento social

Um dos maiores perigos do uso inadequado da IA é o isolamento social. O ser humano é biologicamente e emocionalmente relacional. A construção da identidade, da autoestima e da regulação emocional depende do contato com outras pessoas.

Quando qualquer pessoa passa a substituir conversas reais por diálogos exclusivamente com uma IA, podem ocorrer:

- Redução das habilidades sociais

- Dificuldade de expressar emoções no mundo real

- Aumento da solidão

- Agravamento de quadros de ansiedade e depressão

- Dependência emocional da tecnologia

O que também ocorre com o uso excessivo de redes sociais como já expus na matéria sobre a Economia da Atenção.

Nenhuma inteligência artificial é capaz de oferecer presença, vínculo, empatia genuína ou percepção emocional completa.

A importância da rede de apoio

Família, amigos, escola e comunidade são pilares fundamentais para a saúde mental de adolescentes. Uma rede de apoio saudável permite acolhimento emocional, troca de experiências, sentimento de pertencimento e também a identificação precoce de sinais de sofrimento.

Pais e responsáveis devem estar atentos a mudanças de comportamento, como isolamento excessivo, irritabilidade, tristeza persistente, queda no rendimento escolar e uso intenso e secreto de tecnologia para lidar com emoções.

Quando buscar ajuda profissional

Buscar apoio psicológico não deve ser um tabu, e sim um ato de cuidado e responsabilidade. Profissionais da área de saúde mental são preparados para:

- Avaliar o contexto emocional e social

- Identificar riscos

- Oferecer intervenções terapêuticas baseadas em evidências

- Acompanhar o desenvolvimento emocional de forma segura

A IA pode ser um recurso complementar, mas nunca deve substituir pessoas ou o acompanhamento profissional, especialmente em casos de sofrimento intenso.

Tecnologia como aliada, não como substituta

A inteligência artificial pode ser uma aliada poderosa quando usada com consciência e limites claros. Ela pode informar, organizar ideias e ampliar reflexões para estudos, pesquisas e trabalho. No entanto, saúde mental exige cuidado humano, escuta real e relações vivas.

A responsabilidade é coletiva: famílias, educadores, profissionais de saúde e a sociedade como um todo precisam promover o uso consciente da tecnologia e fortalecer os vínculos humanos.

Em tempos de tecnologia avançada, o maior desafio talvez seja lembrar que nenhuma máquina substitui a presença, o afeto e o apoio de pessoas reais.

Se você ou alguém próximo está passando por sofrimento emocional, procure ajuda profissional.

Clique no botão abaixo, converse comigo e agende sua consulta.